Finanční odborník z nadnárodní společnosti se sídlem v Hongkongu byl údajně podveden a připravil firmu o 25 milionů dolarů (200 milionů hongkongských dolarů), když podvodníci použili během videokonferenčního hovoru falešnou identitu finančního ředitele, který sídlí v Londýně.

Hongkongský pracovník se připojil k videochatu, ve kterém se objevil jeho finanční ředitel - ale vypadal trochu „mimo“. A to natolik, že zaměstnanec byl zpočátku podezřívavý. Uklidnilo ho, ale když se k hovoru připojili další kolegové, které poznal, vysvětlila hongkongská policie.

Falešný finanční ředitel stále naléhavěji žádal o provedení peněžních převodů a oběť pokyny dané během hovoru splnila - nakonec provedla 15 převodů na pět místních bankovních účtů.

Videa generovaná umělou inteligencí byla údajně vytvořena z uložených skutečných online videokonferencí. Aby podvodu dodali hloubku a důvěryhodnost, využili pachatelé aplikaci WhatsApp, e-mail a individuální videokonference s hongkongskými zaměstnanci.

Co přesně se při osudném telefonátu stalo, je sporné. Některé zprávy naznačují, že skutečný byl pouze jeden účastník hovoru, zatímco podle jiných bylo účastníků více. Všichni se shodují, že se objevili lidé generovaní umělou inteligencí a že nejmenovaný finančník byl bohužel podveden. Tuto skutečnost oběť zjistila až poté, co kontaktovala centrálu korporace.

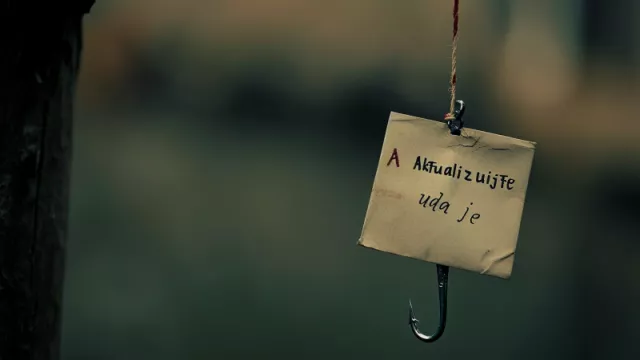

Jak se lze bránit?

Policie už nabídla tipy, jak ověřit pravost osob ve videohovorech, například požádat je, aby pohnuly hlavou, nebo odpověděli na otázky, které potvrdí jejich totožnost, zejména pokud se jedná o žádosti o převod peněz.

Dalším možným řešením deepfake podvodů ve firemním prostředí je vybavit každého zaměstnance párem klíčů a vytvořit důvěru podpisem veřejných klíčů při osobních schůzkách. Později, při vzdálené komunikaci, by tyto podepsané klíče mohly být použity k ověření pravosti stran v rámci schůzky.

Nejde o jediný problém s deepfake

Místní médium The Standard prohlásilo tento incident za první deepfake videokonferenční podvod v Hongkongu. I když je podvod s využitím deepfake možná prvním podvodem nahlášeným v Hongkongu, nejde o jediný podvod využívající tuto technologii. Podle CNN hongkongská policie na pátečním tiskovém brífinku odhalila, že v souvislosti s dalšími deepfake podvody zatkla šest osob a že deepfakes s umělou inteligencí byly použity nejméně dvacetkrát k oklamání softwaru pro rozpoznávání obličejů.

Problém s deepfake je ale globální. Američtí senátoři minulý týden představili návrh zákona, který by umožnil obětem zobrazeným v pornografických deepfakes vytvořených umělou inteligencí žalovat tvůrce těchto videí. Tento krok přišel poté, co se sexuálně explicitní snímky Taylor Swift generované umělou inteligencí rozšířily na platformách sociálních médií - včetně X/Twitteru, kde nasbíraly desítky milionů zhlédnutí, než stránka vlastněná Muskem zablokovala vyhledávání této popové ikony.